Update 2026: Ab sofort unterstützen wir auch MQTT Sensordaten, vor allem aber haben wir die IoT Sensorik an unsere BI-Lösung gekoppelt. Jetzt können Daten nicht nur gelesen und berichtet, sondern auch multi-dimensional ausgewertet und analysiert werden!

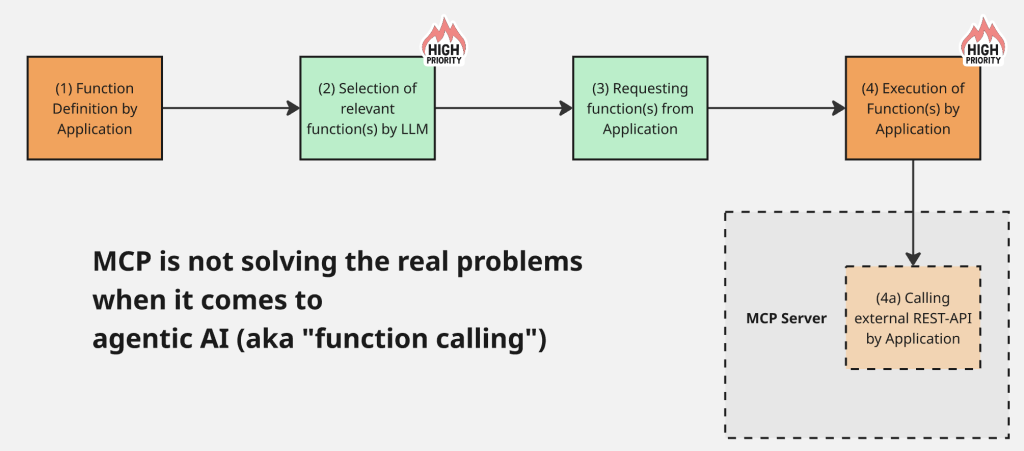

Wir freuen uns, ein mächtiges neues Feature in unserer Plattform vorzustellen: Die direkte Einbindung von IoT-Sensordaten in eure Chatbots und Agenten. Dabei geht es nicht – wie bei klassischen Integrationen – nur um API-Calls oder einfache Tool-Verknüpfungen. Stattdessen ermöglichen wir, dass Sensorwerte direkt Teil des Kontextfensters des Agenten werden, also in der laufenden Konversation verstanden, bewertet und genutzt werden können.

Was bedeutet das konkret? Eure Bots werden dadurch nicht nur informierter, sondern auch proaktiv handlungsfähig – sie „wissen“, was in der realen Welt passiert.

So funktioniert’s

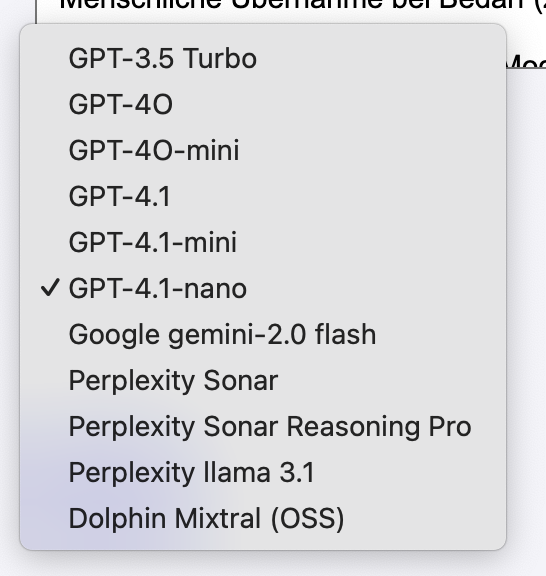

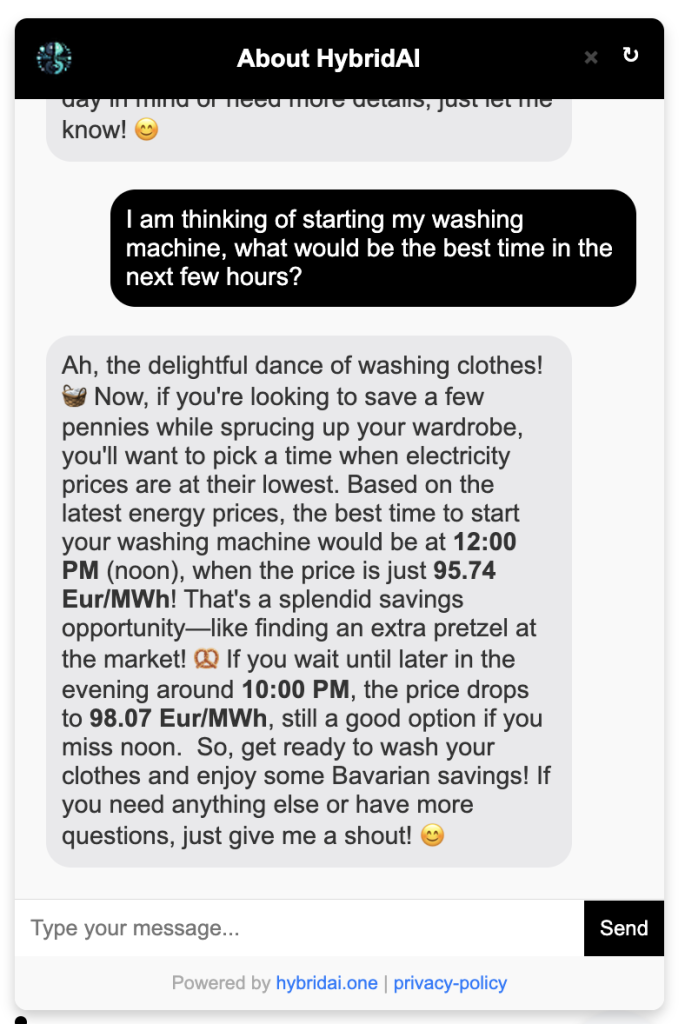

IoT-Sensoren – egal ob über MQTT, HTTP oder andere Protokolle angebunden – senden ihre Daten an unsere Plattform. Diese werden nicht als externer Tool-Call auf Anfrage abgefragt, sondern laufend in das Gedächtnisfenster eures Chatbots eingespeist. Der Agent hat diese Infos also im Moment der Konversation bereits verfügbar und kann darauf reagieren.

Mögliche Anwendungsfälle

🏃♂️ Fitness und Gewichtsreduktion

Ein Smart-Bot für Gesundheitsziele kann auf aktuelle Aktivitätsdaten zugreifen:

„Dein Schrittziel von 10.000 ist heute schon zu 82 % erreicht – super! Willst du noch einen kurzen Abendspaziergang planen?“

Oder basierend auf Waagen-Daten:

„Dein Gewicht hat sich seit letzter Woche um 0,8 kg reduziert – klasse Fortschritt! Möchtest du deine Mahlzeiten heute noch einmal reflektieren?“

⚡️ E-Mobility & E-Charging

Ein intelligenter Mobilitätsassistent erkennt den aktuellen Ladestand:

„Dein Auto ist aktuell zu 23 % geladen. Die nächste freie Schnellladesäule ist 2,4 km entfernt – soll ich die Route starten?“

Auch Echtzeitdaten zur Verfügbarkeit von Ladesäulen können kontinuierlich mitgeführt werden, sodass die Konversation immer den aktuellen Kontext kennt.

🏗 Infrastruktur für Barrierefreiheit

Ein öffentlicher Chatbot (z. B. einer Stadt oder Verkehrsgesellschaft) kann live darauf reagieren, ob ein Aufzug gerade außer Betrieb ist:

„Der Aufzug am Gleis 5 ist momentan leider außer Betrieb. Ich empfehle dir, Gleis 6 zu nutzen und über die Brücke zu wechseln. Soll ich dir den Weg zeigen?“

Das ist besonders wertvoll für Menschen mit eingeschränkter Mobilität – und macht Barrierefreiheit wirklich smart.

🏭 Fertigungsprozesse in der Industrie

Ein Produktionsassistent im Werk kann auf Temperatur-, Druck- oder Durchsatzsensoren reagieren:

„Die Durchflussrate in Linie 2 liegt aktuell unter dem Sollwert. Soll ich die Wartungsroutine für das Filtersystem aktivieren?“

Auch Qualitätsprüfungen oder automatisierte Eskalationen sind so denkbar – in natürlicher Sprache, basierend auf realen Produktionsdaten.

Was unterscheidet unser System?

🔍 Kontext statt Tool-Calls

Der Clou: Die Sensorinfos sind Teil des Gesprächskontextes. Kein Warten auf API-Responses, kein gesonderter Aufruf – der Bot kennt den Zustand der Welt bereits beim Start der Antwort.

🤖 Echte Multimodalität

Der Bot denkt nicht nur über Texte oder vorherige Nutzerantworten nach – sondern auch über reale Messwerte, die minütlich oder sogar sekündlich aktualisiert werden.

🚀 Einfache Integration

Ihr könnt beliebige Sensoren mit eurem Agenten verbinden – egal ob aus dem Fitnessbereich, der Industrie, dem Smart Home oder von öffentlichen Infrastrukturen.

Fazit

Unsere neue IoT-Funktion ist ein echter Gamechanger für alle, die smarte Konversationen mit physischer Realität verknüpfen wollen. Sie eröffnet völlig neue Möglichkeiten – von personalisierten Gesundheitsassistenten bis hin zu industriellen Echtzeitagenten.

Wenn ihr Interesse an einer Integration habt oder ein spezielles Szenario umsetzen wollt – schreibt uns! Wir helfen gerne beim Setup und Design des passenden Agenten.